Adeus silício, bem-vindo carbono (parte 1)

Fonte: http://blogs.forumpcs.com.br/cat/2010/04/19/adeus-silicio-bem-vindo-carbono/

Postado as

05:25 - 19/04/2010 - Por

Carlos Alberto Teixeira.

Categorias:

Computadores, Processadores, Servidores.

Aqui

está ele, o silício, fundamento da indústria eletrônica digital tal

como a conhecemos hoje. Sua hegemonia nesse setor, porém, parece estar

com seus dias contados.

Quase toda essa fascinante tecnologia eletrônica e computacional que

nos cerca baseia-se num elemento químico tão abundante na Natureza que

mal nos damos conta de sua importância — o silício. Foi descoberto em

1787 por Lavoisier como componente da pedra sílex, aquela que o homem

das cavernas usava para produzir fogo, esfregando uma na outra e

produzindo fagulhas que incendiavam galhos e capim secos.

Silício é do que é feita a areia, e é usado também para fabricar

vidro. Este elemento, aliás, tem sido o grande vilão da aviação

comercial na Europa nos últimos dias, pois é o principal constituinte da

poeira expelida pelo vulcão islandês Eyjafjallajökull (nome medonho

que, segundo um amigo meu islandês, pronuncia-se “êia-fiátla-iêkutl”),

cujo silício pode entrar nas turbinas de uma aeronave, derreter e

destruir os mecanismos, depositando no metal uma fina camada parecida

com vidro.

No caso da eletrônica, a principal aplicação do silício é na fabricação de

semicondutor

es, materiais que têm um comportamento entre o condutor e o isolante.

Para produzi-los, pega-se o silício puro e introduz-se nele átomos de

impurezas, num processo conhecido como ”

dopagem “. Esses átomos intrusos podem ser de elementos como arsênio, boro, fósforo e gálio, entre outros.

Esse controle sobre a condutividade do silício dopado é necessário

para produzir componentes de suma importância na indústria eletrônica,

tais como transistores, circuitos integrados, células solares,

microprocessadores e outras peças de alta tecnologia. Um ramo

tecnológico chamado “fotônica de silício”, por exemplo, dedica-se a

produzir guias de onda capazes de conduzir luz coerente ao longo de

circuitos — um processo denominado ”

laser Raman

“. Outra aplicação do silício é em sua forma hidrogenada amorfa (sem

forma), na produção de aplicações eletrônicas de baixo custo e grande

área, como telas LCD e células solares de filme fino.

Estrutura do silício hidrogenado amorfo.

O que vemos, então, na atualidade, é que o silício é o

rei da cocada preta

, quando o assunto é eletrônica digital. Contudo, correndo por fora,

vem despontando um outro elemento químico que é uma grande promessa como

substituto do silício nesse campo — o carbono. Mas, espera aí. Para quê

precisamos de um substituto? Resposta: estamos chegando perto do limite

físico do silício, que cada vez mais estamos forçando com a

miniaturização dos circuitos, o afinamento das trilhas condutoras dentro

dos chips e a demanda por menor consumo elétrico. Em suma, nossa

ganância tecnológica está aos poucos aposentando o bom e velho silício.

E este é o carbono, apresentado aqui em uma de suas estruturas mais comumente encontradas na Natureza — o grafite.

Segundo artigo de R. Colin Johnson, da “EETimes”, o carbono — base de

todos os compostos químicos orgânicos — parece destinado a suplantar o

silício como material escolhido para fabricar semicondutores no futuro.

Esse elemento, que fica logo acima do silício na tabela periódica dos

elementos, será a base de várias estruturas que podem o silício em

termos de desempenho térmico, alcance de frequências e talvez até em

supercondutividade. As perspectivas que se abrem com o uso do carbono na

indústria eletrônica são formidáveis e, aliás, há cerca de dois anos,

já

escrevi um pouco sobre o tema aqui no Fórum PCs.

Dentre as tecnologias do carbono, as do diamante são provavelmente as

mais próximas de entrar no mercado no presente momento, considerando

que os trabalhos científicos e experimentais com diamantes nessa área já

estão acontecendo há mais de 15 anos. Para quem não se lembra, o

diamante é feito de átomos carbono arranjados em uma estrutura cúbica

muito sólida, que lhe confere o título de material mais duro da

Natureza. As outras estruturas atômicas envolvendo carbono ainda estão

muito atrás do diamante em termos de proximidade de comercialização em

aplicações tecnológicas. Mas, que outras estruturas são essas?

Este

é um corte circular realizado em uma camada de diamante produzida por

CVD (Chemical Vapor Deposition = deposição química a vapor) com 500

micra de espessura.

Eis aqui uma única placa de CVD de diamante, produzida nos laboratórios da Universidade de Uppsala, na Suécia.

Vamos pensar matematicamente em termos de dimensões. Dimensão “zero”

equivale a um ponto; dimensão “um” é uma linha; dimensão “dois”

corresponde a uma superfície, uma área; e dimensão “três” representa um

volume. Portanto, na família das estruturas carbônicas, temos o carbono

tridimensional simbolizado pelo diamante, uma estrutura com volume e que

oferece dez vezes mais dissipação de calor do que o silício.

Fornecedores experimentais atualmente conseguem produzir finas camadas

(chamadas “filmes”) de 40 nanômetros a 15 micra de diamante por sobre

waffers de silício.

Ilustração da estrutura de um diamante, uma rede volumétrica compacta, duríssima e bem amarrada.

Essa

estrutura é a do grafite, composta dos mesmos átomos que o diamante,

mas disposta em camadas que escorregam umas sobre as outras, daí o pó de

grafite ser usado às vezes como lubrificante.

Descendo uma dimensão, temos as superfícies bidimensionais em

monocamada com espessura de 3 angstrom chamadas grafeno, capazes de

permitir que os elétrons se movimentem nela dez vezes mais rápido do que

no silício, ultrapassando a barreira do velho material e permitindo

desempenhos da ordem de Terahertz.

Uma

sonda do NIST (National Institute of Standards and Technology) escaneia

e mapeia os contornos atômicos do grafeno por meio da aplicação de um

campo magnético que faz com que seus elétrons se organizem em órbitas de

ciclotron, ou seja, quase circulares. (Fonte “EETimes”)

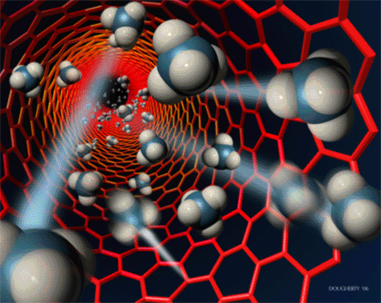

Baixando mais uma dimensão, temos os nanotubos de carbono, com 1

nanômetro de diâmetro, capazes de suplantar as barreiras de velocidade

impostas pelo silício. Esses nanotubos aparecerão primeiramente no

mercado como “tintas” imprimíveis, que permitirão velocidades dez vezes

superiores às dos transistores orgânicos cujos protótipos já estão em

operação.

Geometria de nanotubos

Imagem colorida de nanotubos

Nanotubos carbônicos logo após sua geração

E, caindo para a dimensão zero — o ponto — temos as esferas

carbônicas com 60 átomos desse elemento, e que são chamadas fulerenos.

Elas podem significar a resposta à incapacidade do silício em atingir

supercondutividade em altas temperaturas. Apenas lembrando,

supercondutividade é quando um elemento apresenta resistência zero à

passagem de corrente elétrica. Amostras compactadas de fulerenos

intercalados com átomos de metais alcalinos apresentam

supercondutividade a 38º Kelvin, o que equivale a-235,15º C.

Nesse ponto, o leitor achará estranho considerar 38º Kelvin uma alta

temperatura. Acontece que esse conceito é muito relativo, quando se

trata de supercondutividade. Qualquer coisa mais quente do que 30º K já é

tida como alta temperatura sob essa ótica, especialmente se tal medida

se aproximar dos 77º K, que é temperatura do ponto de ebulição do

nitrogênio líquido, material relativamente barato de se obter.

Fibra

de alto desempenho de nanotubos de carbono com dupla-parede após

auto-colapso, em experimento realizado pelo departamento de ciência dos

materiais e metalurgia da Universidade de Cambridge, na Inglaterra.

Mas independentemente de frio ou quente, o que nós presenciaremos nos

próximos anos será que as tecnologias de processamento de carbono se

tornarão mais economicamente viáveis e substituirão quase todos os

materiais empregados na fabricação de circuitos hoje em dia — condutores

para interligar dispositivos; semicondutores; e isolantes. Só não se

pode precisar em quanto tempo exatamente chegaremos a esse ponto,

especialmente numa economia mundial sujeita (como sempre será) às

flutuações causadas por catástrofes financeiras que vêm pipocando aqui e

ali.

Empresas de tecnologia de ponta estão unindo esforços nessa área. Foi o que aconteceu em 2008 com a

Nantero e a

SVTC , que

firmaram parceria

para oferecer o primeiro serviço de forja para desenvolvimento de

filmes finos de nanotubos de carbono.Quem está gostando muito disso são

os fabricantes de chips, que pretendem integrar filmes de nanotubos em

interconexões de alto desempenho em circuitos CMOS comerciais. As

aplicações incluem células solares, LEDs, sensores, MEMS e outros

dispositivos baseados em semicondutores. O problema é que o consórcio de

empresas ainda está tendo dificuldades em encontrar clientes que

queiram comercializar os dispositivos fabricados com essa técnica.

Para termos uma referência, tendo em vista a integração de

dispositivos dentro de chips CMOS abaixo de 22 nanômetros, por exemplo,

ainda faltam cerca de cinco anos antes que os pioneiros do mercado

consigam comercializar nanotubos de carbono à altura. Se bem que esse

material já está sendo produzido em massa por empresas especializadas

como a DuPont, e já apareceram no mercado como camadas depositadas em

substratos de plástico flexível por gigantes de indústria, como a NEC.

Diamantes

podem ser duros, mas agregados amorfos de fulereno são ainda mais. Uma

medida chamada “módulo de compressibilidade isotérmica” tem o valor de

442 GPa (Gigapascals) para o diamante, e de 491 Gpa para o fulereno

amorfo. O problema é que fulerenos não são encontrados originalmente na

Natureza e produzi-los ainda é caro. No entanto, depois da “Idade do

Diamante” na eletrônica, certamente veremos surgir a “Idade dos

Fulerenos”, quando estes dominarão a ciência dos materiais. Mas isso

será coisa para nossos filhos ou talvez netos verem, não nós.

Outras empresas vêm adotando estratégicas de produção diferentes, como é o caso da

Nanocomp

, que está aplicando nanotubos em folhas de carbono que podem ser

usadas para detectar rachaduras e outras falhas estruturais em materiais

críticos. A empresa também desenvolve fios e cabos de nanotubos que são

comparáveis aos feitos de cobre em termos de condutividade elétrica,

com a vantagem de serem 80% mais leves.

Na semana que vem continuarei no tema, apresentando os novos e

promissores horizontes que se abrem com essa formidável tecnologia que

decerto revolucionará o desempenho dos dispositivos eletrônicos em

breve.

Bioeletrônica: É

a tecnologia de bio-nano-sensores (sensores contruídos com

nanotecnologia, usando materias biológicos) e na engenharia neural. São

dispositivos de interface com tecidos neurais.

Bioeletrônica: É

a tecnologia de bio-nano-sensores (sensores contruídos com

nanotecnologia, usando materias biológicos) e na engenharia neural. São

dispositivos de interface com tecidos neurais.

Imageamento óptico:

As tecnologias baseadas em imagens ópticas serão cada vez mais

utilizadas para o diagnóstico e para o acompanhamento do câncer, das

doenças cardiovasculares e outras doenças fibróticas.

Imageamento óptico:

As tecnologias baseadas em imagens ópticas serão cada vez mais

utilizadas para o diagnóstico e para o acompanhamento do câncer, das

doenças cardiovasculares e outras doenças fibróticas. Bio-robôs: “As

aplicações clínicas, terapêuticas e cirúrgicas dos robôs médicos com

instrumentação avançada, sensores, atuadores e sistemas de tempo real

podem ter um impacto revolucionário na medicina e no cuidado da saúde”,

afirmou Dhawan.

Bio-robôs: “As

aplicações clínicas, terapêuticas e cirúrgicas dos robôs médicos com

instrumentação avançada, sensores, atuadores e sistemas de tempo real

podem ter um impacto revolucionário na medicina e no cuidado da saúde”,

afirmou Dhawan.